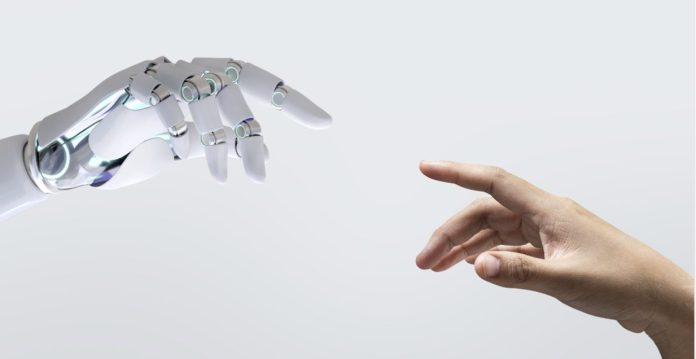

e-Réputation & Avis client : l’IA est utile mais ne se substituera jamais à l’Humain

En pratique, tout avis mériterait une réponse personnalisée, adaptée et bienveillante mais en réalité, le paysage digital étant si vaste, les clients peuvent s’exprimer à peu près partout : sites, moteurs de recherche, réseaux sociaux… pour ne citer qu’eux.

Les marques ne peuvent tout simplement pas répondre à chaque avis posté sur la toile. Certaines marques espèrent que les grands modèles linguistiques (LLMs) les aideront à répondre à cette lourde tâche. Mais alors l’IA pourrait-elle vraiment les épauler dans cette démarche qui demande de l’écoute et de la compréhension ?

Les LLMs ne se suffisent pas à eux-mêmes

Les LLMs tels que GPT-3 ne peuvent se substituer à l’humain car ils n’ont pas accès à toutes les informations relatives aux produits, aux services ou aux historiques des clients. Faute d’informations actualisées pour mieux comprendre le contexte lié à un avis, les réponses automatisées peuvent vite être génériques ou inexactes.

Par ailleurs, des secteurs pointus tels que la santé et la banque / finance/ assurance requièrent un sens de la nuance et un vrai souci de précision.

En règle générale, les LLMs vont pouvoir comprendre l’idée globale de l’avis client, mais peuvent être induits en erreur par des subtilités de langages (ironie ou sarcasme par exemple), et par conséquent, ne faire preuve d’aucune empathie. Cela représente une situation risquée car les internautes peuvent se sentir offensés s’ils ont l’impression que leur avis n’est pas pris au sérieux à travers une réponse inappropriée. Pour sonner justes, les réponses aux avis doivent être personnalisées avec un ton approprié et inclure des informations précises tout en reflétant l’esprit de la marque.

Alors comment intégrer habilement l’IA dans la gestion des avis ?

Les êtres humains ne peuvent pas répondre à tous les avis et les capacités d’apprentissage illimitées des LLMs peuvent vite déraper. Si une erreur survient dans les échanges avec les internautes, il est délicat d’implanter des LLMs à large échelle pour améliorer la gestion des avis.

Pourquoi ne pas utiliser l’IA générative comme un brouillon ? Qu’il s’agisse d’une situation usuelle ou délicate, l’être humain peut alors intervenir sur toutes les réponses apportées. Pour les avis sensibles ou ceux nécessitant une contextualisation, le contenu proposé par l’IA est une base de travail utile.

Au lieu de partir de zéro, l’être humain dispose d’une base sur laquelle il peut apporter des modifications et ainsi enrichir l’apprentissage du LLM tout en gagnant du temps.

Quels sont les points d’attention pour répondre aux avis avec l’aide de l’IA ?

En passant à la vitesse supérieure grâce à l’IA, il est important de mettre en œuvre les meilleures pratiques et de s’assurer que l’approche fluidifie aussi bien les flux de contenus proposés par l’IA que ceux conçus manuellement.

Quatre points doivent être évalués :

1. Être en mesure de donner aux LLMs des instructions sur le ton ou le langage à adopter

Grâce à leurs longues expériences avec leurs clients, les marques doivent pouvoir paramétrer finement les LLMs en leur donnant des instructions sur la manière de générer des réponses aux avis, selon un niveau de langage, un ton approprié ou encore selon un nombre de phrases. Pour les cas particuliers, il est nécessaire de les détecter et d’intégrer dans les instructions pré-paramétrées, des informations spécifiques comme par exemple, l’inclusion d’un point de contact dédié lorsqu’un avis nécessite d’être orienté vers une aide supplémentaire.

2. Former les LMMs au ton de la marque, à son style de réponse et aux meilleures pratiques

Pour gagner en efficacité, l’outil de gestion des avis doit s’inspirer des réponses précédentes. Cela permet à l’outil de générer des réponses pertinentes et conformes à la marque tout en offrant aux services client et au community management un gain temps précieux dans l’apport de réponses fiables.

3. Intégrer les informations commerciales utiles dans les réponses générées par l’IA

Toute information utile, dont le consommateur aurait besoin, est toujours bonne à (ap)prendre. Un emplacement, les horaires d’ouverture, les produits et les services, et même, les coordonnées du service client, sont des informations importantes à inclure dans les réponses. Cependant, cela suppose que les LLMs disposent d’un grand nombre d’informations sur la marque. Pour intégrer ces données, l’outil de réponse aux avis doit être compatible avec les logiciels tiers dans l’optique de tirer parti des bases de données de la marque, comme par exemple celles issues d’un CMS.

4. Contrôler les réponses pour préserver l’image de la marque

Pour tout outil d’IA générative, et en particulier ceux qui s’intègrent à d’autres plateformes, plusieurs types d’utilisateurs devraient être déterminés pour mieux anticiper les biais d’erreur. En effet, certains utilisateurs doivent uniquement être en mesure d’approuver ou de refuser les réponses générées par l’IA, tandis que d’autres peuvent être autorisés à modifier les réponses proposées. La nécessité d’avoir des garde-fous est cruciale, non seulement pour la publication d’une réponse mais aussi pour l’ensemble du processus d’apprentissage de l’IA.

La génération de contenu basée sur l’IA est un outil très puissant.

La génération de réponses aux avis peut être avantageuse et profitable aussi bien aux marques qu’aux clients si toutefois, la bienveillance et l’esprit de la marque sont réunis. Impliquer le service clients et le community management dans cette approche hybride, homme-machine, peut offrir des économies de temps et de ressources mais il faut des moyens de contrôle appropriés pour conserver la nature humaine des relations garantissant à la fois la satisfaction des consommateurs et la réputation de la marque.